综述篇

本周是2018年华中科技大学同学来休斯敦大学进行暑期实习的第十周。在导师们和学长学姐们的指导和带领下,大部分同学的项目已经步入正轨。在项目的进程中,我们遇到了许多困难和意想不到的发现,但通过和老师的交流,将困难化成机遇,将新发现当作突破口,我们也在逐渐成长。

个人篇

UH实习日志|李昌

本周是来到休斯顿的第10周,由于本周五要进行自己的暑期工作总结汇报,本周未进行太多的实验工作,工作时间都在准备组会汇报。

导师在上周四回国出差,因此本周的工作也未涉及到许多实验。主要的任务还是总结前期的工作,为周五的汇报进行准备。总结过去的70多的天的工作,自己承担了研究Li2DHBQ在锂离子电池作为正极材料的充放电机理的工作。从最开始的合成方法的摸索,粉末样品的表征,再到电池的装配,测试和分析,自己一路过来得到了许多提升。无论是在实验的设计到完成,还是数据的收集和分析,都得到了导师和师兄们的指导,有了许多进步。而自己最初想要学习的理论计算方面,虽然在指导我的师兄去阿贡实验室交流之后没有太多的进步,但自己仍然学到了许多,知道了理论计算是做什么,该怎么做,自己都有了一个大致的了解,也具备了一定的理论计算能力,算是入了门,但由于自己的背景和理论计算所需的相差太多,仍然需要很多知识积累和经验来达到真正的掌握这门技能。

此外,本周五我和两个朋友一起去了NASA进行参观。对美国的航空航天历史有了一些了解,对阿波罗登月的历史有了更清晰和直观的认识。最让我开心的是亲手触摸了来自月球和火星的石头!

UH实习日志|张紫荆

这是来到休斯顿的第十周,却还没有好好在休斯顿各处逛逛,刚好周末我的好朋友达维要从凤凰城飞来休斯顿看我,于是我们一起展开了两天的休斯顿之旅。

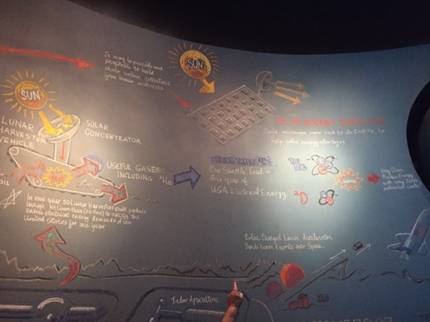

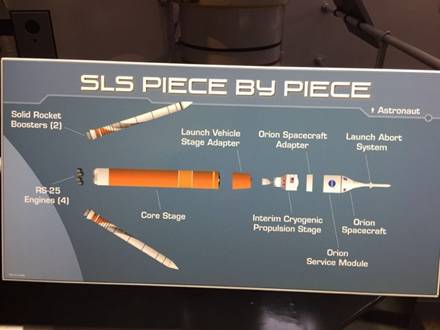

休斯顿可能最值得一看的地方就是NASA space center 了。NASA Johnson Space Center是美国最大的航天研究,生产及控制中心。美国的航天火箭,航天飞机都是在佛罗里达发射的,但是所有的控制都是在这儿完成的,也是1969年登月的控制中心。人类第一次登上月球的阿波罗飞船11号,就在休斯顿约翰逊航天中心升空。一个很有意思的事件是,人类在月球上说到的第一个单词就是Houston,因为要呼叫地面指挥中心。这里同时也是美国载人航天飞机的研发基地和载人太空飞行基地。展区面积不大,但是分为好几个部分,外围的展区介绍一些天文学知识还有航空发动机等一些科学知识,展示太空飞行器的模型以及登月和历代载人航天的宇航服。影院展厅展示美国航空航天发展记录。周六这天还非常幸运得能够听到NASA的宇航员的报道,但是由于我们的时间比较紧所以错过了报告的时间。

阿波罗十一号登月时的月球车

可以触摸探测器从火星和月球带回来的石块

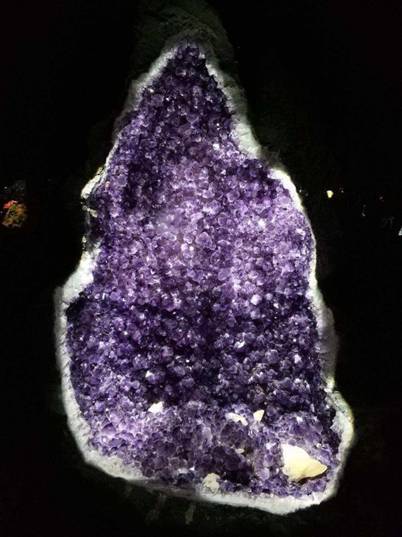

我们一大早先来到了自然科学博物馆,本来以为这个博物馆只需要一个多小时就可以逛完,但其实,我们用了三个小时才大致浏览完。休斯顿的自然科学博物馆非常值得一去,一共有四层展区。一层的主题是生命的演化,有许多古生物进化的化石,从三叶虫到恐龙到早期智人,应有尽有。二层展示了德州,非洲的野生动物标本,和埃及美洲印第安人的文化遗迹。但是最让作为材料专业的我和我的小伙伴激动的是天然矿石的展区,这个战区展示了许多美丽的天然矿石结晶。

色彩斑斓的蛋白石

置身绚烂的矿石展区当中,感觉好像进入了一个宝藏的世界。博物馆的三层是昆虫标本站以及昆虫微观摄影展示,通过微观摄影,向观众们表现昆虫的翅膀,触角,眼睛等等部位的微观结构。第四层是工业电气展,主要是向小朋友们科普现在和未来的能源动力的发展现状和前景。

随后我们来到了休斯顿知名的学府莱斯大学。作为一所私立院校,莱斯大学被称为南方的哈佛,是由德克萨斯州的棉花巨富威廉马歇尔1891年创建。莱斯大学的校园非常美丽,绿树环绕校园四周,校园对面就是赫曼公园和休斯敦动物园。距离Museum of Fine Art 和Museum of Natural Science都不远。莱斯大学的建筑看起来优雅大气,同时又能感觉到历史的印记。

UH实习日志|关晨宇

来休斯顿已两月有余,想来听力和口语方面应该是有了一个数量级的进步。于是抱着试试看的心态报了本周六的托福考试。自然这周就必须要重新拾起备考托福的各种资料准备一番了。

按着脱产复习的方法,周一到周五大约每天从早上到中午都会带着耳机按1.25倍的速度精听TPO的材料。下午到晚上的时间被分配给了口语,直观上来看现在即使不准备口语的段子也不至于大脑空白想不到词,虽然效果上还是有些磕磕绊绊。但即使对independent speaking充满的信心,自己还是在综合口语这边前进得比较艰难——原来是因为平时听听力都没有记笔记的习惯,自己记笔记的能力直线下降,这对综合口语来说似乎不是什么好事情,毕竟这里听力和笔记才是口语的基础。于是整个一周花在这个上面的时间似乎比其他部分都要更多一些。周六考试的时候倒也算是磕磕绊绊讲完了吧。 写作和阅读倒是没有太多准备。因为有了之前考GRE写作时训练了很多话题以及打字速度,这次托福至少不用担心没话写以及写不完。事实证明这样的训练果然十分有用,两篇作文敲完之后都还剩了5到10分钟来检查拼写,字数方面也是远超题目标准字数要求。阅读方面确实没时间准备了,临考前粗粗读了两篇TPO阅读熟悉一下感觉也就罢了。总而言之,周六的托福感觉上还是比较轻松的,至于结果如何,就听认考官们的安排了。

不过这周实验室方面还是做了一些东西的。因实验需要我们需要用氧化铝乳液打磨一个光亮的纯度为99.999%的金块,于是这个无聊又要求高的任务被无情地安排在了我头上。从1um一直打磨到0.05um,显微镜下眼看这金块上的scratch和pots一点一点消失殆尽,还是挺佩服自己的手工活儿的~

UH实习日志|赵隽逸

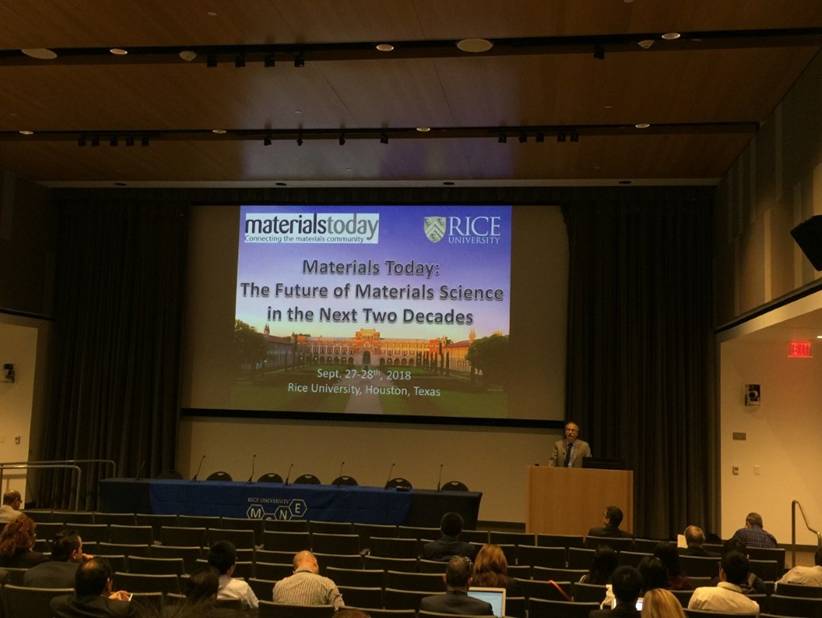

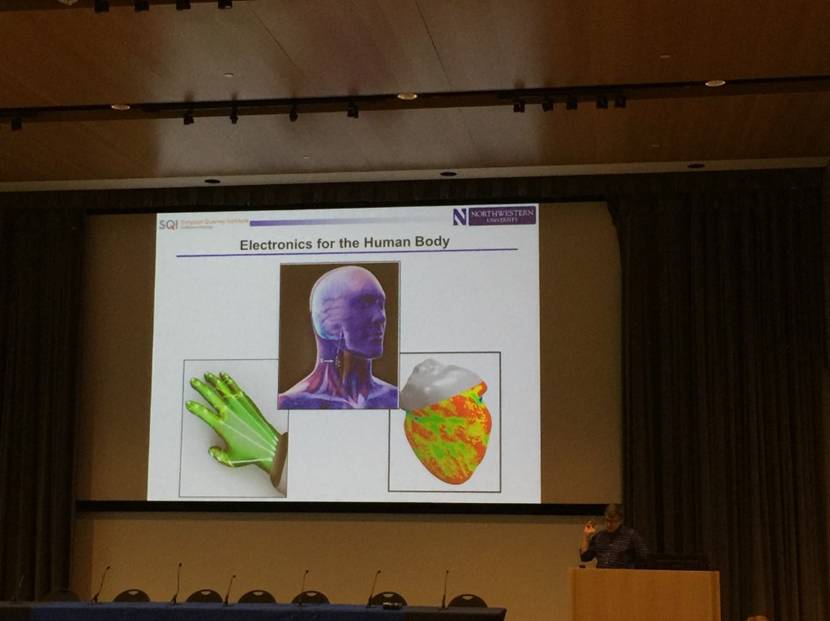

本周的大事件就是我有幸参加了在Rice University举办的 主题为Materials Today: Materials Science for The Next Two Decades的Research Conference. 这场会议的级别非常之高,到场做report 的嘉宾全是领域里的大师级人物,都是google scolar引用量在五六万以上的巨佬,以及一些领域里的新星教授。其中flexible electronics领域的Prof. John Rogers以及Soft Materials 领域的Prof. Xuanhe Zhao是我最期待的两位教授,能够有幸见到这两位柔性电子与柔性材料领域的大佬是我梦寐以求的事情。除了这两位教授之外,还有许多其他的业界大佬,比如rice university 的Prof. Ajayan (引用量11万)等等。

参加这次会议收获颇丰,除了见到了许多大佬,更重要的是了解到了未来二十年材料科学领域的发展动态。同时一些大佬的report也让我对现在正在进行的项目有了很多启发。其中来自UT-Austin 的Prof. Yuebing Zheng的研究方向是与我现在做的磁流体的课题非常相关, 他做的是laser beam manipulate particles并且已经发了六七篇high-quality的文章了,甚至包括nature子刊和science advance等杂志。这也不禁让我对我现在的课题充满了期待

同时,我发现我之前做的一个有关plasma nozzle的研究与Prof. Xuanhe Zhao在nature上发的一个有关3D printing nozzle的研究的思路非常接近。都是希望利用调焦的思路来调节喷嘴喷出物的直径,以及提高分辨率的作用。

Anyway, 超级激动超级荣幸能够参加这次会议,收获颇丰,不虚此行。

UH实习日志|梁子云

这已经是我在美国的第八周。这周在紧张和忙碌中度过,在做实验的同时准备国家奖学金的答辩。很感谢在国内帮忙答辩的同学。在这周中,我继续用不同模型训练我经过预处理的图片。一方面继续熟练自己的编程能力,另一方面继续提高训练准确度。

以 Alexnet为例

1. AlexNet模型的特点

· 使用了非线性激活函数:ReLU

· 防止过拟合的方法:Dropout,数据扩充(Data augmentation)

· 其他:多GPU实现,LRN归一化层的使用

1.1 使用ReLU激活函数

传统的神经网络普遍使用Sigmoid或者tanh等非线性函数作为激励函数,然而它们容易出现梯度弥散或梯度饱和的情况。

在AlexNet中,使用了ReLU (Rectified Linear Units)激励函数替代Sigmoid/tanh,由于ReLU是线性的,且导数始终为1,计算量大大减少,收敛速度会比Sigmoid/tanh快很多。

1.2 数据扩充

当训练数据有限时,可以通过一些变换从已有的训练数据集中生成一些新的数据,以快速地扩充训练数据。其中,最简单、通用的图像数据变形的方式:水平翻转图像,从原始图像中随机裁剪、平移变换,颜色、光照变换。

AlexNet在训练时,在数据扩充(data augmentation)这样处理:

(1)随机裁剪,对256×256的图片进行随机裁剪到224×224,然后进行水平翻转,相当于将样本数量增加了((256-224)^2)×2=2048倍;

(2)测试的时候,对左上、右上、左下、右下、中间分别做了5次裁剪,然后翻转,共10个裁剪,之后对结果求平均。作者说,如果不做随机裁剪,大网络基本上都过拟合;

(3)对RGB空间做PCA(主成分分析),然后对主成分做一个(0, 0.1)的高斯扰动,也就是对颜色、光照作变换,结果使错误率又下降了1%。

1.3 重叠池化

一般的池化(Pooling)是不重叠的,池化区域的窗口大小与步长相同。在AlexNet中使用的池化(Pooling)却是可重叠(Overlapping)的,也就是说,在池化的时候,每次移动的步长小于池化的窗口长度。AlexNet池化的大小为3×3的正方形,每次池化移动步长为2,这样就会出现重叠。重叠池化可以避免过拟合。

1.4 局部归一化(Local Response Normalization,简称LRN)

归一化(normalization)的目的是“抑制”,局部归一化就是来实现局部抑制,尤其当使用ReLU时,因为ReLU的响应结果是无界的(可以非常大),所以需要归一化。使用局部归一化的方案有助于增加泛化能力。LRN的核心思想就是利用临近的数据做归一化。

1.5 Dropout

引入Dropout主要是为了防止过拟合。在神经网络中Dropout通过修改神经网络本身结构来实现,对于某一层的神经元,通过定义的概率将神经元置为0,这个神经元就不参与前向和后向传播,就如同在网络中被删除了一样,同时保持输入层与输出层神经元的个数不变,然后按照神经网络的学习方法进行参数更新。在下一次迭代中,又重新随机删除一些神经元(置为0),直至训练结束。

Dropout也可以看成是一种模型组合,每次生成的网络结构都不一样,通过组合多个模型的方式能够有效地减少过拟合,Dropout只需要两倍的训练时间即可实现模型组合(类似取平均)的效果,非常高效。

1.6 多GPU训练

AlexNet当时使用了GTX580的GPU进行训练,在每个GPU中放置一半核(或神经元),将网络分布在两个GPU上进行并行计算,大大加快了AlexNet的训练速度。

AlexNet的特点和创新之处,总结如下表:

算法 |

作用 |

ReLU、多个GPU |

提高训练速度 |

重叠池化 |

提高精度,不容易产生过拟合 |

局部归一化 |

提高精度 |

数据扩充、Dropout |

减少过拟合 |

在周末,我听了Taylor Swift的演唱会--reputation stadium tour。我在美国俄勒冈州读初中时,开始爱上她的歌,一晃已经过去了九年,单曲循环过她的每一首歌。用我自己的奖学金买下将近300美元的门票,度过了最难忘的一晚。

UH实习日志|熊雨琴

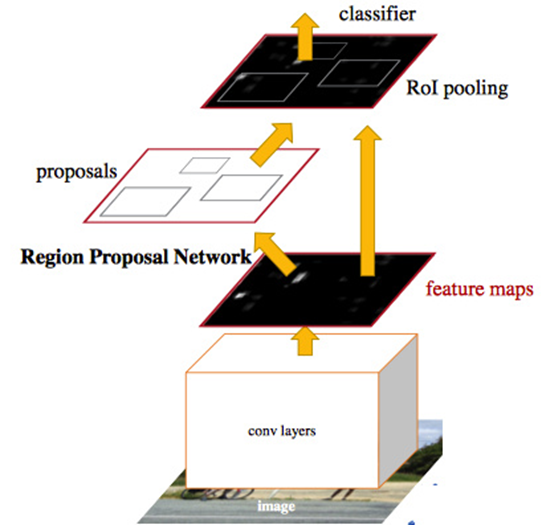

这周,我进一步阅读了deep lesion数据库的文章,发现他们主要是用Faster RCNN的方法来进行训练。Faster RCNN是目标检测领域比较新的方法,得到的结果也比较好。

这幅图比较简单明了的说明了它的结构,Faster RCNN可以分为4个主要内容:

1. Conv layers。 Faster RCNN首先使用一组基础的conv+relu+pooling层提取image的feature maps。该feature maps被共享用于后续RPN网络和分类网络,这一部分可以理解为基础网络部分,通常使用VGG或resnet。

2. Region Proposal Networks。RPN网络用于生成region proposals。该部分判断anchors属于foreground或者background,RPN网络里面的前景和背景的网络就相当于一个‘注意力’机制,再利用bounding box regression修正anchors获得比较精确的proposals。

3. Roi Pooling。该层使用基础网络输出的feature maps和proposals(rois),生成固定大小的proposal feature maps,送入后续分类网络判定目标类别。

4. Classification。 所有的RCNN系列的方法都把检测的问题转换为对图片的局部区域的分类问题,利用proposal feature maps计算proposal的类别,同时再次bounding box regression获得检测框最终的精确位置。

Faster RCNN使用RPN来避免选择性搜索方法,它加速了训练和测试过程,并提高了性能。

文章中最后达到的结果是81.1%的sensitivity当平均每张图有5个FPs。

UH实习日志|李宛泽

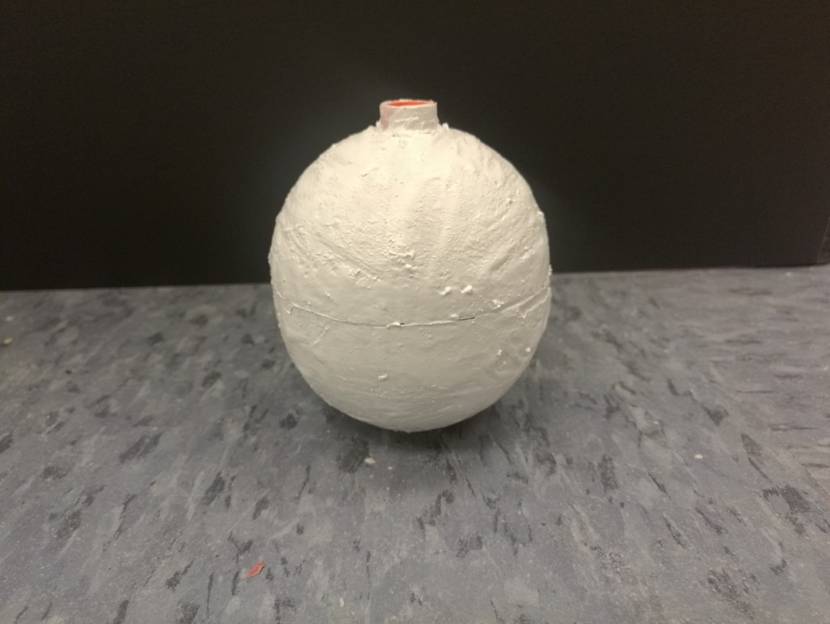

本周的主要任务仍然是继续对整体式传感器外壳进行测试,主要问题还是外壳经常只能被崩成两半,而不是成为设想中的碎片。对于这个情况,我先是将横向和纵向上外壳薄弱线的厚度进行了调整,其次设计了一些方案试图在外壳内部产生一个大于外壳极限的压力,还有就是想办法提高外壳的气密性。说来有些可笑,我花了很大功夫来研究如何在外壳内部产生一个大压力,还想过在壳体内部加设一个密封球壳,但是气密性又难以保证。后来在实验室里找到了一台大功率气泵,希望下周能测试下,解决这个问题,如果一切顺利,我就要开始考虑如何在外壳内部设置气源的问题了。

另外,本周六我去考了一场托福,这周也付出了一些时间来进行准备,但是感觉并不十分理想,希望结果不要太糟吧。